Отмина ли времето на лесните пари от изкуствения интелект?

Милиарди в хардуер, но AGI остава далеч – технологичната индустрия осъзнава, че само мащабирането не е пътят към истински интелигентен AI

Милиарди в хардуер, но AGI остава далеч – технологичната индустрия осъзнава, че само мащабирането не е пътят към истински интелигентен AI

Парите са решение, но не и за абсолютно всичко.

Като цяло това е позицията на изследователи на изкуствения интелект в едно скорошно проучване. Запитани дали „увеличаването на мащаба“ на настоящите подходи към AI може да доведе до постигане на изкуствен общ интелект (AGI) или AI с общо предназначение, който да се равнява или да надминава човешкото познание, преобладаващата част от анкетираните отговарят, че това е „малко вероятно“ или „много малко вероятно“ да успее.

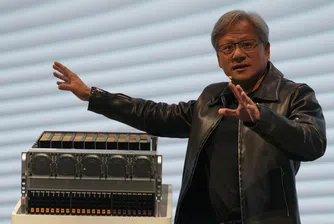

Резултатите от проучването, в което са участвали 475 изследователи на изкуствения интелект са категоричен отпор на отдавна предпочитания от технологичната индустрия метод за постигане на напредък - снабдяване с повече хардуер на генеративните модели и центровете за данни, които се използват за тяхното обучение и работа. Като се има предвид, че всички разработчици твърдят, че това е крайната им цел, може спокойно да се каже, че мащабирането се възприема като задънена улица.

„Огромните инвестиции в мащабиране, които не са придружени от сравними усилия да се разбере какво се случва, винаги са ми се стрували неуместни“, казва пред NewScientist Стюарт Ръсел, компютърен учен от Калифорнийския университет в Бъркли, който е помогнал за организирането на доклада.

„Мисля, че преди около една година за всички започна да става ясно, че ползите от прекомерните инвестиции са се изчерпали.“

В надпреварата за въоръжаване с изкуствен интелект се хвърлят колосални суми. Инвестициите са достигнали над 56 млрд. долара само под формата на финансиране с рисков капитал през 2024 г., съобщава TechCrunch. Голяма част от тези средства се изразходват за изграждане или управление на огромни центрове за данни. Microsoft, например, се ангажира да похарчи 80 млрд. долара за AI инфраструктура през 2025 г.

От това следва, че търсенето на енергия е също толкова зашеметяващо. Microsoft подписа договор за пускане в действие на цяла ядрена електроцентрала само за центровете си за данни, а конкурентите му Google и Amazon също сключиха грандиозни сделки с ядрена енергия.

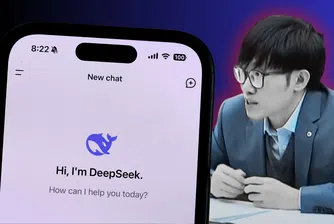

Предположението, че изкуственият интелект може да се подобрява безкрайно чрез мащабиране, винаги е било на нестабилна основа, пише Futurist. Пример за това е екзистенциалната криза в технологичния сектор, предизвикана от китайския стартъп DeepSeek, чийто модел на изкуствен интелект може да се изправи срещу водещите чатботове на Запада, струващи милиарди долари, като разходите за обучение и мощността му са доста по-скромни.

Разбира се, това се виждаше и преди това. През ноември миналата година изследователите на OpenAI откриха, че предстоящата версия на големия езиков модел GPT показва значително по-малко подобрения, а в някои случаи и никакви подобрения, отколкото предишните версии в сравнение с техните предшественици.

През декември главният изпълнителен директор на Google Сундар Пичай официално заяви, че лесните печалби от AI са „свършили“ - но уверено добави, че няма причина индустрията да не може „просто да продължи да увеличава мащаба си“.

Проучват се по-евтини и по-ефективни подходи. OpenAI използва метод, известен като test-time compute (изчисление по време на теста), при който АI отделя повече време за „мислене“, преди да избере най-обещаващото решение. Така се постига повишаване на производителността, което иначе би изисквало планини от мащабиране, за да се възпроизведе, твърдят изследователите.

Но този подход е „малко вероятно да бъде сребърен куршум“, казва Арвинд Нараянан, компютърен учен от Принстънския университет, пред NewScientist.

Междувременно DeepSeek е пионер в подхода, наречен „смес от експерти“, който използва множество невронни мрежи, всяка от които е специализирана в различни области - пословичните „експерти“ - за да помогне за намирането на решения, вместо да се разчита на един-единствен модел „генералист“.

Независимо от това, ако ангажиментът на Microsoft да продължи да харчи десетки милиарди долари за центрове за данни е някакъв показател, грубата сила на мащабиране все още ще бъде предпочитан похват за титаните в индустрията - докато на по-едрите стартиращи компании ще им остане да търсят начини да правят повече с по-малко.

)

&format=webp)

&format=webp)

&format=webp)

&format=webp)

&format=webp)

&format=webp)

&format=webp)

&format=webp)